Sollte zu öffnen «Blackbox» der künstlichen Intelligenz, bis es zu spät ist

Source:

Source:

Seit mehreren Jahren in den 1980er Jahren eintretenden Medical School Krankenhaus St. Georg in London ausgewählt hat, unter Verwendung der High-Tech-Methode. Ein Computerprogramm, das eines der ersten seiner Art, Zusammenfassung durchgeschaut, die Auswahl aus allen Bewerbungen in der Größenordnung von 2000 Kandidaten pro Jahr. Das Programm Analysierte Aufzeichnungen über die Einnahmen durch das Studium der Eigenschaften von erfolgreichen Bewerbern und montiert, solange Ihre Entscheidungen nicht übereinstimmen mit der Meinung der Auswahlkommission.

Aber das Programm gelernt, mehr finden, als gute Noten und Zeichen der akademischen Leistungen. Vier Jahre nach der Umsetzung des Programms zwei ärzte im Krankenhaus festgestellt, dass das Programm in der Regel lehnt die Frauen-Bewerber und Personen mit nicht-indoeuropäischen Namen, unabhängig von Ihrer akademischen Verdienste. Ärzte festgestellt, dass etwa 60 Bewerbern jedes Jahr nur verweigert Interview wegen Ihres Geschlechts oder Rasse. Das Programm umfasste geschlechtsspezifische und rassische Vorurteile in die Daten, die Sie für Ihre Ausbildung — in der Tat, lernte, dass die ärzte und die Aliens sind nicht die besten Kandidaten in den Arzt.

Dreißig Jahre später sind wir konfrontiert mit einem ähnlichen Problem, aber Programme mit den inneren Vorurteilen nun breiter verteilt und Entscheidungen mit noch höheren Einsätzen. Die algorithmen der künstlichen Intelligenz, basierend auf machine learning, überall verwendet werden, beginnend mit Regierungsstellen und öffentliche Gesundheit bis hin zu Entscheidungen und Vorhersagen, basierend auf historischen Daten. Durch das Studium der Gesetzmäßigkeiten in den Daten, die Sie auch absorbieren und Vorurteile in Ihnen. Google, zum Beispiel, zeigt mehr Werbung Niedriglohnjobs Frauen als Männer; eintägige Versand Amazon vorbei Musikrichtungen, die Nachbarschaften und Digitalkameras mit Mühe erkennen die Person nicht weiß.

Schwer zu verstehen, ob der Algorithmus voreingenommen oder Fair, und so glauben auch die Computer-Experten. Einer der Gründe besteht darin, dass die Details der Erstellung des Algorithmus gelten oft patentierten Informationen, so dass Ihre Besitzer sorgfältig bewachen. In komplexeren Fällen-algorithmen sind so Komplex, dass selbst die Macher nicht genau wissen, wie Sie funktionieren. Das Problem der sogenannten «Blackbox» KI — unsere Unfähigkeit zu sehen, das innere des Algorithmus und zu verstehen, wie er zur Lösung kommt. Wenn Sie ihn eingesperrt, unsere Gesellschaft stark beeinträchtigt werden kann: in der digitalen Umgebung realisiert werden historische Diskriminierung, mit denen wir viele Jahre gekämpft, von der Sklaverei und Leibeigenschaft bis zu Diskriminierung von Frauen.

Diese Angst klangen in kleinen Gemeinschaften informatik früher, jetzt gewinnt eine ernste Wendung. In den letzten zwei Jahren in diesem Bereich gab es Recht viele Publikationen über die Transparenz der künstlichen Intelligenz. Zusammen mit diesem Bewusstsein wächst und das Gefühl der Verantwortung. «Ob es möglicherweise irgendwelche Dinge, die sollten wir nicht bauen?», fragt sich Kate Crawford, Forscher an Microsoft und Mitbegründer von AI Now Insitute in New York.

«Maschinelles lernen endlich in den Vordergrund. Jetzt versuchen wir es verwenden, um Hunderte von verschiedenen Aufgaben in der realen Welt», sagt rich Caruana, Senior researcher von Microsoft. «Es ist durchaus möglich, dass Menschen in der Lage, erweitern bösartige algorithmen, die erhebliche Auswirkungen auf die Gesellschaft langfristig. Nun scheinen plötzlich alle verstanden, dass es ein wichtiges Kapitel in unserer Region».

Eigenwillige Algorithmus

Wir sind seit langem algorithmen verwenden, aber das Problem der Flugschreiber hat keine Präzedenzfälle. Die ersten algorithmen waren einfach und transparent sein. Viele von Ihnen haben wir bisher verwenden — zum Beispiel für die Beurteilung der Kreditwürdigkeit. Bei jeder neuen Verwendung kommt die Regulierung.

«die Leute benutzten algorithmen für die Beurteilung der Kreditwürdigkeit seit Jahrzehnten, aber in diesen Bereichen waren ziemlich starke Siedlung, die wuchs parallel mit dem Einsatz von предиктивных algorithmen», sagt Caruana. Die Regeln der Verordnung gewährleisten, dass die algorithmen zur Vorhersage Erklärung geben jedem Punkt: Sie wurden abgelehnt, weil Sie einen großen Kredit oder zu niedriges Einkommen.

In anderen Bereichen wie Rechtssystem und Werbung, es gibt keine Regeln, verbieten die Verwendung von wissentlich непросчитываемых algorithmen. Sie können nicht wissen, warum Sie abgelehnt Kredit oder keine Arbeit haben, denn niemand zwingt den Besitzer des Algorithmus zu erklären, wie es funktioniert. «Aber wir wissen, dass da die algorithmen trainiert auf Daten der realen Welt, müssen Sie voreingenommen — weil die Reale Welt voreingenommen», sagt Caruana.

Betrachten Sie zum Beispiel die Sprache — eine der offensichtlichsten Quellen von Bias. Wenn die algorithmen trainiert im geschriebenen Text, Sie prägt eine gewisse Assoziation zwischen den Wörtern, die häufiger gemeinsam auftreten. Zum Beispiel, Sie lernen dazu, dass «für Männer Computer-Programmierer sein — es ist dasselbe, was für eine Frau Hausfrau sein». Wenn dieser Algorithmus berechnet eine passende Zusammenfassung für die Arbeit der Programmierer, wahrscheinlich, er wählt unter den männlichen Kandidaten.

Solche Probleme ganz einfach zu beheben, aber viele Unternehmen es einfach nicht gehen. Stattdessen werden Sie zu verbergen ähnliche Diskrepanzen unter dem Schild geschützten Daten. Ohne Zugriff auf die Details des Algorithmus, die Experten in vielen Fällen nicht in der Lage, festzustellen, Vorurteil oder nicht.

Da diese algorithmen sind geheim und bleiben außerhalb der Zuständigkeit der Aufsichtsbehörden, Bürgern fast unmöglichverklagen den Machern von algorithmen. Im Jahr 2016 der oberste Gerichtshof von Wisconsin lehnte den Antrag einer Person zu prüfen, die interne Arbeit COMPAS. Mann, Eric Loomis, wurde verurteilt zu sechs Jahren Haft zum Teil, weil die COMPAS fand ihn «mit hohem Risiko». Loomis sagt, dass es das Recht auf angemessenen Verfahren verletzt wurde die Abhängigkeit des Richters von einem undurchsichtigen Algorithmus. Der endgültige Antrag auf Verhandlung vor dem obersten Gerichtshof der USA scheiterte im Juni 2017.

Aber verschwiegen, dass die Firmen nutzen Ihre Freiheit für unbegrenzte Zeit. März die Europäische Union nimmt die Gesetze, die erfordern von Unternehmen die Möglichkeit zu erklären den interessierten Kunden, wie Ihre algorithmen funktionieren und wie Sie Entscheidungen treffen. Die USA haben keine solchen Gesetze in der Entwicklung.

Blackbox Forensik

Egal, ob die Aufsichtsbehörden involviert in alles, kulturelle Verschiebung, wie entwickelt und implementiert algorithmen zur Prävalenz gegenstandslosen algorithmen. Da immer mehr Unternehmen und Programmierer verpflichten sich, Ihre algorithmen transparent und объяснимыми, einige hoffen, dass die Unternehmen, die dies nicht tun, verlieren einen guten Ruf in der öffentlichkeit.

Das Wachstum der Rechenleistung erlaubt, algorithmen zu erstellen, die sind und feinsten, und объяснимыми — dieses technische Problem konnten die Entwickler nicht historisch zu überwinden. Neuere Studien zeigen, dass es möglich ist, erstellen erklärbar Modelle, die einen Rückfall kriminelle Subjekte so genau wie eine BLACK Box Kriminalisten wie COMPAS.

«Alles ist bereit — wir wissen, wie man die Modelle ohne BLACK boxes», sagt Cynthia Rudin, Dozent der informatik und Elektrotechnik an der Duke University. «Aber nicht so einfach, die Aufmerksamkeit der Menschen zu dieser Arbeit. Wenn Regierungsagenturen mehr zahlen für ein Modell der BLACK Box, das würde helfen. Wenn die Richter sich weigern, die Verwendung von Blackbox für die Aburteilung, wird es auch helfen».

Andere arbeiten, um sich mit einem Mittel zur überprüfung der Fairness-algorithmen, indem Sie ein System von Kontrollen und балансировок, bevor der Algorithmus wird veröffentlicht in die Welt, wie der Test verläuft jedes neue Medikament.

«Jetzt Modelle gemacht und zu schnell bereitgestellt werden. Nicht durchgeführt angemessene Kontrollen vor der Veröffentlichung des Algorithmus in das Licht», sagt Sarah tan von der Cornell University.

Im Idealfall sollten Entwickler Flächenstilllegung bekannten Bias — Z. B. nach Geschlecht, Alter und Rasse — und die Ausführung der internen Simulation für die überprüfung der algorithmen auf das Vorhandensein von anderen Problemen.

Mittlerweile, bevor Sie zu Fuß bis zu dem Punkt, wenn alle algorithmen werden vor der Veröffentlichung gründlich getestet, schon gibt es die Möglichkeit zu bestimmen, welche von Ihnen leiden Bias.

In seiner neuesten Arbeit Tang, Caruana und Ihre Kollegen haben eine neue Art und Weise zu verstehen, was passiert sein könnte unter der Haube Blackbox-algorithmen. Wissenschaftler haben ein Modell, das simuliert Blackbox-Algorithmus, lernen, bewerten das Risiko рецидивизма laut COMPAS. Auch Sie haben ein anderes Modell, das studierte Sie nach Angaben der realen Welt, die zeigen, ob stammte vorausgesagte рецидивизм. Ein Vergleich der beiden Modelle konnten die Wissenschaftler bewerten die Genauigkeit der projizierten Punkte, nicht die Analyse des Algorithmus. Die Unterschiede in den Ergebnissen der beiden Modelle zeigen können, welche Variablen wie Rasse oder Alter, können wichtiger sein in diesem oder jenem Modell. Ihre Ergebnisse zeigten, dass die COMPAS voreingenommen gehört zu den schwarzen Menschen.

Richtig gebaut algorithmen beseitigen können langjährige Vorurteile im Bereich der Strafrechtspflege, Polizei-Aktivitäten und vielen anderen Bereichen der Gesellschaft.

Mehr:

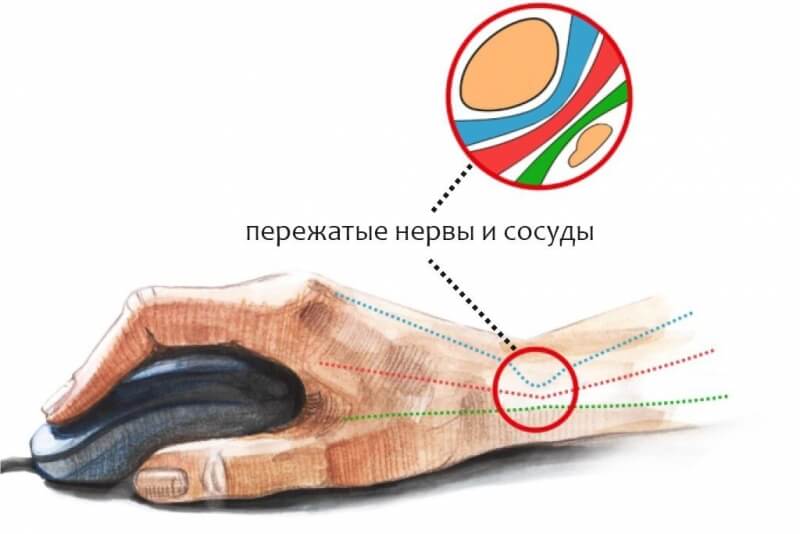

Warum schlecht lange sitzen am Computer und wie man es beheben

Ich hab vor kurzem eine kleine Umfrage unter Freunden und bekannten darüber, wie Sie bewerten Ihre Wirksamkeit bei der Remote-Arbeit. Fast alle, die ich kenne — jetzt arbeiten von zu Hause am Computer und Telefon. Wobei, wie sich herausstellte,...

Die parametrische Architektur: ob die künstliche Intelligenz die Technik der Stadt?

Wenn Sie denken über die Zukunft, welche Muster stehen Sie vor den Augen? Als Amateur ретрофутуризма – Genre dessen Grundlage die Vorstellungen der Menschen der Vergangenheit über die Zukunft, ich habe immer stellte sich die Stadt der Zukunft застрое...

Wie funktioniert der Arbeitsspeicher Ihres Computers?

Alle Daten in den Computer — diese Nullen und Einheit. Der Text, den Sie gerade Lesen, передался von unserem Server direkt auf Ihren Computer und trat in den Speicher — er ist eine Folge von Nullen und Einsen. Vorbereitet werden Sie auf I...

Verwandte News

Deaktiviert die automatische Aktualisierung von Windows 10? Ins Gefängnis!

das Betriebssystem Windows 10 hat viele verschiedene Funktionen und Möglichkeiten, zu verstehen, es ist manchmal sehr schwierig. Aber die Nutzer dieses OS zu bemerken, dass einer Ihrer wichtigsten Nachteile ist die erzwungene heru...

NASA finanziert die Schaffung блокчейн-Service für Weltraumforschung

Experten Акронского Universität aus den USA erforschen die Möglichkeit der Schaffung блокчейн-Service, das berechnen der Flugbahn der Satelliten, so dass Sie zu vermeiden Kollision mit kosmischen Müll. Für die weiteren arbeiten in...

EU ausgeben 1 Milliarde Euro für die Entwicklung von eigenen Supercomputer

Informations-analytischen Ausgabe von Bloomberg mit der Verbannung auf die Erklärung der europäischen Kommission meldet, dass die Europäische Union geht zu 1 Milliarde Euro, um aufzuholen mit China, den USA und Japan in der Entwic...

Wird es jemals eine künstliche Intelligenz mit Bewusstsein?

Vergessen Sie die modernen bescheidenen Erfolge im Bereich der künstlichen Intelligenz, wie selbst Autos. Eigentlich alle warten auf etwas anderes: eine Maschine, die erkennt die Existenz und die Umwelt und die Verarbeitung von gr...

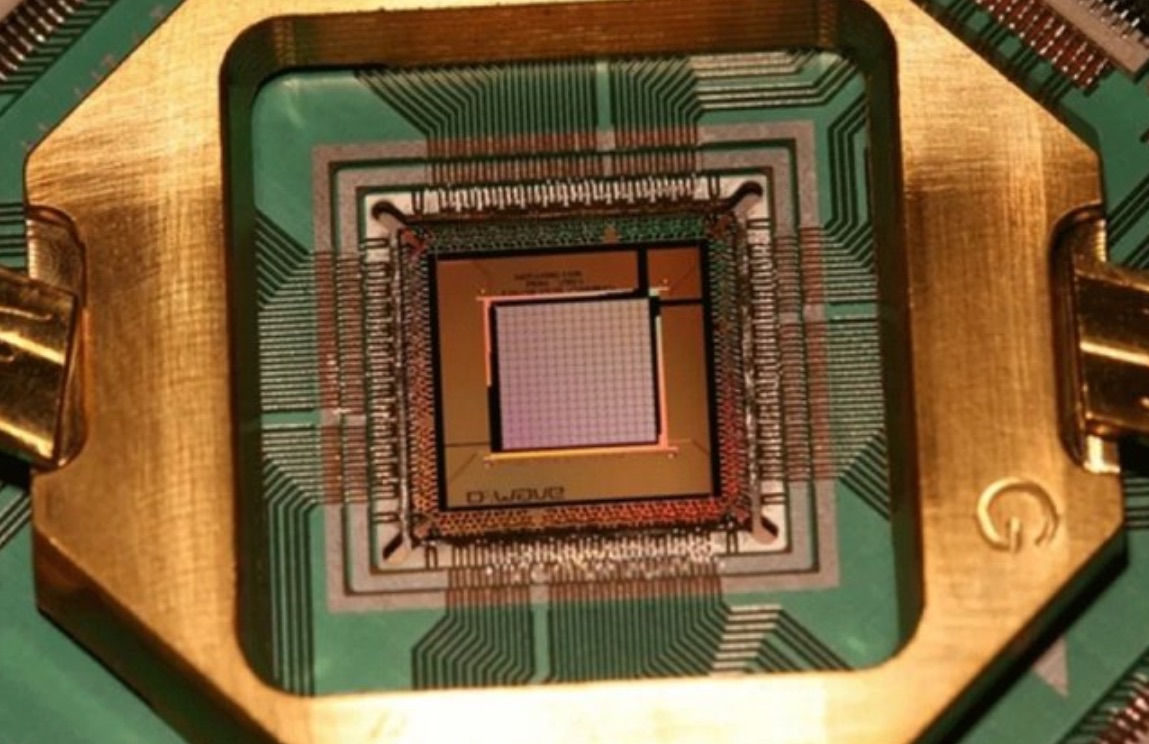

Microsoft veröffentlicht ein Kit für Entwickler Quanten-Computing

Ständig wachsenden Tempo der Entwicklungen im Bereich der Quantencomputer ermöglichen sicher zu sagen, dass eine vollwertige Quantencomputer wird noch erstellt. Aber für die Entwicklung von Programmen auf Quanten-Computern erforde...

Google geht voll auf erneuerbare Energie

der Suchmaschinengigant Google arbeitet an seiner vollständigen Umstellung auf erneuerbare Energie. Vor kurzem hat die Gesellschaft unterzeichnete Verträge mit drei neuen Windkraftanlagen Stationen, eine davon befindet sich in Sou...

CNN-Journalisten fanden in Moskau die riesige Farm für den Bergbau

die Großen Mining-Farmen keine überraschung, in China oder im Norden Europas, während in Russland eher wenig — jetzt auf Sie entfallen nur etwa drei Prozent des gesamten Netzwerks . Aber es gibt Helden und «in unseren п...

Der gestrige Viren-Erpresser war ergänzt und reparierter NotPetya

Virus-Schlüßler, versuchend, greifen die Russischen Banken und die der Computer der Reihe der ukrainischen Organisationen und der Russischen Massenmedien, wird als BadRabbit. Die Spezialisten des Unternehmens «Group-IB»,...

Snapdragon PC — warum und Wann abreisen?

Smartphones — kompakte, leichte und dünne Geräte, so dass wir auf vieles, was «kann» - PC. Allerdings haben viele intelligente Telefone haben einen entscheidenden Nachteil — die sich in Ihren dünnen gehäusen Batterien ...

Google weiß, was zu tun mit den alten Computern

eine schnelle Verbesserung der Computertechnik gibt es auch weniger angenehm, als die dazugehörige Fortschritt Produktivität und Funktionalität, Aspekt. Sie ist sehr schnell veraltet, obwohl technisch könnte noch ein Jahr nicht ar...

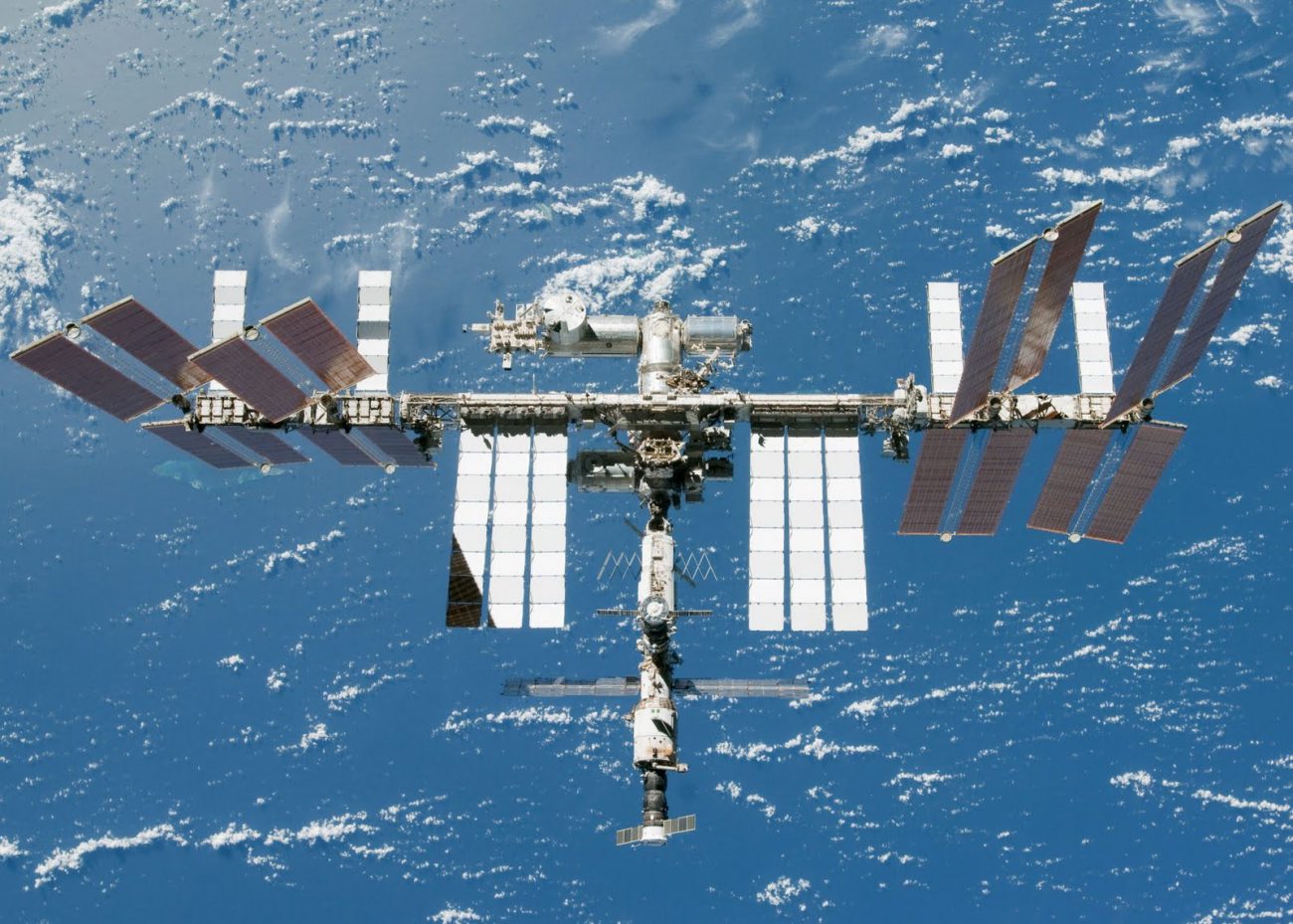

Supercomputer von Hewlett-Packard im Weltraum erlebt

vor einem Monat an Bord der ISS im Frachtraum Frachter Dragon kam Supercomputer SpaceBourne, entwickelt gemeinsam von der NASA und Hewlett-Packard. Es wurde geschaffen, um zu lernen, wie ein solches High-Tech-Ausrüstung wird man s...

Wissenschaftler haben einen ersten Chip Quanten-Speicher

Wissenschaftler große Hoffnungen auf , die das Phänomen der Quanten-Superposition und Quanten-Verschränkung für die Verarbeitung und übertragung von Daten. Aber bisher niemandem gelungen ist, schaffen Quanten-Speicherchips. Die Mi...

Wurden die ersten Tests der Technologie der Quanten-4D-Codierung

Traditionelle coding-Technologie für die übertragung von Informationen verwenden das Binärsystem. Dabei werden auch Möglichkeiten, die sich jetzt Quanten-Informationsübertragung basieren auch auf einem System von Daten mit zwei Va...

DARPA erstellt modulare Computer auf Basis von «чиплетов»

Wir haben bereits über die so genannten «чиплетах» — dünne Silizium-Platten, die in irgendeiner Weise eine переосмысляющих das Konzept der traditionellen Schaltkreisen. Entwickelt von den Ingenieuren Palo Alto Research Cente...

Das bekannteste Computergesellschaft geht auf Android?

Laut einem neuen Bericht, einer der führenden Computer-Unternehmen der Welt untersucht den Wechsel Ihrer beabsichtigten in Erster Linie für die Unternehmen Geräte auf Android. Doch das wird nicht bedeuten, eine vollständige Ablehn...

HP Enterprise sendet auf der ISS Supercomputer

Entwickelt von HPE und NASA Supercomputer Spaceborne Computer läuft auf «Linux», gehen zu liefern auf der ISS mit einer Rakete von SpaceX am kommenden Montag, — berichtet Techcrunch. Dort, nach den Worten der Vertr...

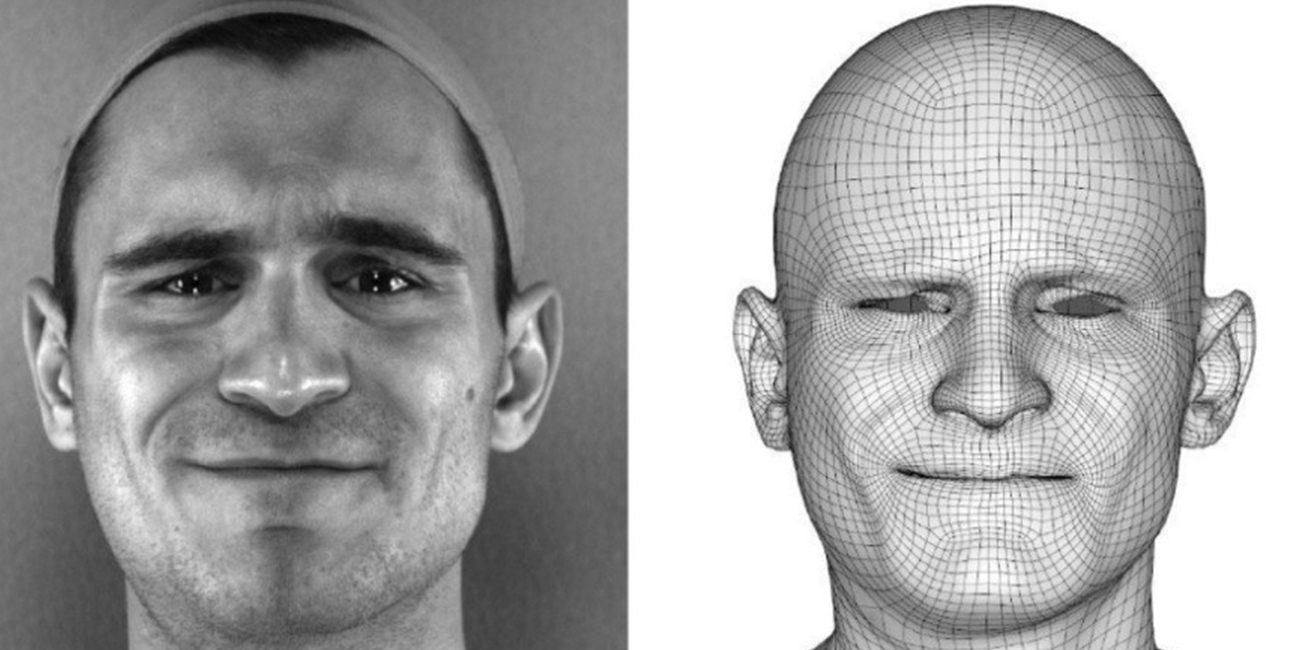

Die KI von NVIDIA gelernt zu zeichnen 3D-Grafik menschlich

Auf der Konferenz SIGGRAPH (Special Interest Group on Graphics and Interactive Techniques — eine Spezielle Gruppe für grafische und interaktive Methoden) NVIDIA zeigte seinen neuen KI fähig ist die Erstellung von dreidimensi...

Aus Escherichia coli haben biocomputers

Wie berichtet die Redaktion der Zeitschrift Nature, die Gruppe der Genetiker von der Harvard University es geschafft zu verwandeln E. coli in eine Art Biologischer Computer. Auf der Basis von Bakterien haben sogar eine logische Sc...

Sechs Beispiele, wenn Quantencomputer sind uns sehr helfen

Computer sind nicht in einem luftleeren Raum. Sie lösen Probleme und Probleme, die Sie lösen, hängt ganz Hardware. GPUs verarbeiten Bild; - Prozessoren der künstlichen Intelligenz ermöglichen die Arbeit von KI-algorithmen; Quanten...

Quantencomputer sind in der Lage, sehr komplexe Berechnungen durch die einzigartige Architektur, aber trotz der Tatsache, dass Sie die Zukunft sind, eine sehr schwierige Gerät Quantencomputer nicht können, um eine ausreichend leis...

Kommentare (0)

Dieser Artikel wurde noch kein Kommentar abgegeben, sei der erste!