Штучний інтелект і Джеффрі Хінтон: батько «глибокого навчання»

Source:

Source:

Штучний інтелект. Скільки про нього сказано, а ми навіть і говорити ще толком не починали. Майже все, що ви чуєте про прогрес штучного інтелекту, засноване на прорив, якого тридцять років. Збереження темпів прогресу потребує обходу серйозних обмежень серйозних обмежень. Далі від першої особи — Джеймс Сомерс.

Я стою там, де скоро буде центр світу, чи просто у великій кімнаті на сьомому поверсі блискучою башти у центрі Торонто — з якого боку подивитися. Мене супроводжує Джордан Джейкобс, співзасновник цього місця: Інституту Вектор, який восени цього року відкриває свої двері і обіцяє стати глобальним епіцентром штучного інтелекту.

Ми в Торонто, тому що Джеффрі Хінтон в Торонто. А Джеффрі Хінтон — батько «глибокого навчання», техніки, що лежить в основі ажіотажу на тему ІІ. «Через 30 років ми оглянемося назад і скажемо, що Джеф — Ейнштейн для ШІ, глибокого навчання, все, що ми звемо штучним інтелектом», говорить Джейкобс. З усіх дослідників ШІ Хінтона цитують частіше, ніж трьох йдуть за ним, разом узятих. Його студенти та аспіранти йдуть працювати в лабораторії ІІ в Apple, Facebook і OpenAI; сам Хінтон — провідний вчений в команді Google Brain AI. Практично будь-яке досягнення в області ШІ за останні десять років — у перекладі, розпізнавання мови, розпізнавання зображень і іграх — так чи інакше стосується роботи Хінтона.

Інститут Вектор, цей пам'ятник сходження ідей Хінтона, є дослідницьким центром, в якому компанії зі всіх США і Канади — на кшталт Google, Uber і NVIDIA — спонсорують зусилля по комерціалізації технологій ІІ. Гроші вливаються швидше, ніж Джейкобс встигає про це попросити; двоє з його співзасновників опитували компанії в області Торонто, і попит на експертів у галузі ШІ виявився в 10 разів вище, ніж Канада поставляє кожен рік. Інститут Вектор в деякому сенсі неорана цілина для спроби мобілізувати світ навколо глибокого навчання: щоб вкластися у цю техніку, навчити їй, відточити і застосовувати. Дата-центри будуються хмарочоси наповнюються стартапами, в область вливаються цілі покоління студентів.

Коли стоїш на підлозі «Вектора», складається відчуття, що ви на початку чогось. Але глибоке навчання, по своїй суті, дуже старе. Проривна стаття Хінтона, написана разом з Девідом Румельхартом і Рональдом Вільямсом, була опублікована в 1986 році. У роботі докладно описувався метод зворотного поширення помилки (backpropagation), «бэкпроп», якщо коротко. Бэкпроп, за словами Джона Коена, — це «все, на чому ґрунтується глибоке навчання — взагалі все».

Якщо дивитися в корінь, сьогодні ШІ — це глибоке навчання, а глибоке навчання — це бэкпроп. І це вражає, враховуючи, що бэкпропу більше 30 років. Розібратися в тому, як так вийшло, просто необхідно: як техніка могла чекати так довго і потім стати причиною вибуху? Тому що як тільки ви дізнаєтеся історію бэкпропа, ви зрозумієте, що зараз відбувається з ІІ, а також і те, що ми можемо і не стояти на початку революції. Можливо, ми в кінці такої.

Прогулянка від Інституту Вектора в офіс Хінтона в Google, де він проводить більшу частину свого часу (він тепер почесний професор Університету Торонто) — це свого роду жива реклама для міста, принаймні влітку. Стає зрозуміло, чому Хінтон, який родом з Великобританії, переїхав сюди в 1980-х після роботи в Університеті Карнегі — Меллона в Піттсбурзі.

Може бути, ми не в самому початку революції

Торонто — четвертий за величиною місто Північної Америки (після Мехіко, Нью-Йорка і Лос-Анджелеса) і вже точно різноманітніше: більше половини населення було народжене за межами Канади. І це видно, коли ходиш по місту. Натовп багатонаціональна. Є безкоштовна охорона здоров'я і хороші школи, люди доброзичливі, політики щодо ліві і стабільні; все це приваблює людей начебто Хінтона, який каже, що виїхав з США через «Ірангейту» (Іран-контрас — великий політичний скандал в США другої половини 1980-х років; тоді стало відомо про те, що окремі члени адміністрації США організували таємні поставки зброї в Іран, порушуючи тим самим збройне ембарго проти цієї країни). З цього починається наша розмова перед обідом.

«Багато хто вважав, що США цілком можуть вторгнутися в Нікарагуа», говорить він. «Вони чомусь вважали, що Нікарагуа належить США». Він розповідає, що нещодавно здійснив великий прорив у проекті: «Зі мною почав працювати дуже хороший молодший інженер», жінка по імені Сара Сабур. Сабур іранка, і їй було відмовлено у візі для роботи в США. Офіс Google в Торонто витягнув її.

Хинтону 69 років. У нього гостре, худорляве англійське обличчя з тонким ротом, великими вухами і гордим носом. Він народився в Уїмблдоні і в розмові нагадує оповідача дитячої книжки про науку: цікавий, заманює, намагається все пояснити. Він забавний і трохи грає на публіку. Йому боляче сидіти з-за проблем зі спиною, тому літати він не може, а на прийомі в дантиста лягає на пристосування, що нагадує дошку для серфінгу.

У 1980-х Хінтон був, як і зараз, експертом по нейронних мереж, значно спрощеної моделі мережі нейронів і синапсів нашого мозку. Однак у той час було твердо вирішено, що нейронні мережі — глухий кут у дослідженнях ІІ. Хоча сама перша нейронна мережа «Перцептрон» була розроблена в 1960-х роках та її вважали першим кроком у напрямку машинного інтелекту людського рівня, що в 1969 році Марвін Мінскі і Сеймур Паперт математично довели, що такі мережі можуть виконувати лишенайпростіші функції. У цих мереж було всього два шари нейронів: шар введення і шар виводу. Мережі з великим числом шарів між нейронами введення і виведення могли, в теорії, розв'язувати широке розмаїття проблем, але ніхто не знав, як їх навчати, так що на практиці вони були марними. З-за «Перцептронов» від ідеї нейронних мереж відмовилися майже всі за кількома винятками, включаючи Хінтона.

Прорив Хінтона в 1986 році полягав у тому, щоб показати, що метод зворотного поширення помилки може навчати глибоку нейронну мережу з кількістю шарів більше двох або трьох. Але знадобилося ще 26 років, перш ніж збільшилася обчислювальна потужність. У статті 2012 року Хінтон і два його студента з Торонто показали, що глибокі нейронні мережі, навчені із застосуванням бэкпропа, обійшли найкращі системи розпізнавання зображень. «Глибоке навчання» почало набирати обертів. Світ відразу вирішив, що з ранку ІІ захопить владу. Для Хінтона це була довгоочікувана перемога.

Поле спотворення реальності

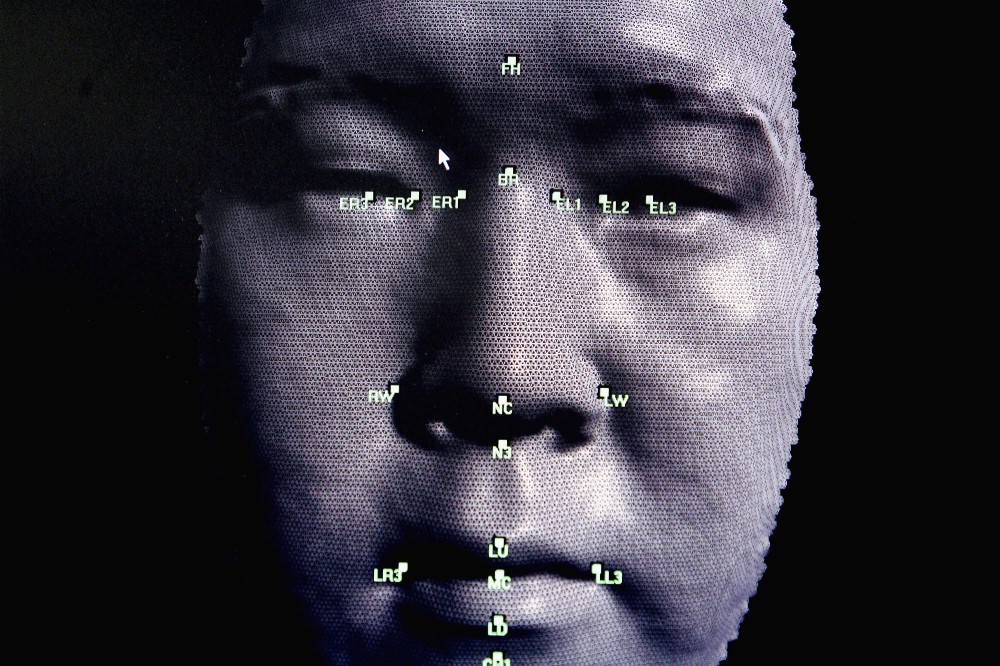

Нейронна мережа зазвичай зображується як сендвіч, шари якого накладені один на одного. Ці шари містять штучні нейрони, які по своїй суті представлені малими обчислювальними одиницями, які збуджуються — як порушується даний нейрон — і передають це хвилювання іншим нейронам, з якими з'єднані. Збудження нейрона представлено числом, скажімо, 0.13 або 32.39, яке визначає ступінь збудження нейрона. Є інше важливе число, на кожному із з'єднань між двома нейронами, що визначає, скільки порушення повинно передаватися від одного до іншого. Це число моделює силу синапсів між нейронами мозку. Чим вище число, тим сильніше зв'язок, а значить більше збудження перетікає від одного до іншого.

Одним з найбільш успішних застосувань глибоких нейронних мереж стало розпізнавання зображень. Сьогодні існують програми, здатні розпізнати, чи є на картинці хот-доги. Якихось десять років тому вони були неможливі. Щоб змусити їх працювати, спершу потрібно взяти картинку. Для простоти скажемо, що це чорно-біле зображення 100 на 100 пікселів. Ви згодовуєте його нейронної мережі, встановлюючи порушення кожного модельованого нейрона у вступному шарі так, що воно буде дорівнює яскравості кожного пікселя. Це нижній шар сендвіча: 10 000 нейронів (100 х 100), що представляють яскравість кожного пікселя зображення.

Потім цей великий шар нейронів ви підключаєте до іншого великого шару нейронів, вже вище, скажімо, в кілька тисяч, а їх, у свою чергу, до іншого шару з декількох тисяч нейронів, але вже менше і так далі. Нарешті, верхній шар сендвіча — шар виводу — буде складатися з двох нейронів — одного, що представляє «хот-дог», а іншого — «не хот-доги». Ідея в тому, щоб навчити нейронну мережу порушувати тільки перший з цих нейронів, якщо на картинці є хот-доги, і другий, якщо немає. Бэкпроп, метод зворотного поширення помилки, на якому Хінтон побудував свою кар'єру, робить саме це.

Бэкпроп вкрай простий, хоча краще всього працює з величезною кількістю даних. Ось чому великі дані так важливі для ІІ — чому з таким завзяттям займаються Facebook і Google і чому Vector Institute вирішив налагодити зв'язок з чотирма найбільшими лікарнями Канади і обмінюватися даними.

В даному випадку дані приймають форму мільйонів зображень, деяких з хот-догами, деяких без; трюк у тому, щоб позначити ці зображення як мають хот-доги. Коли ви створюєте нейронну мережу вперше, з'єднання між нейронами мають випадкові ваги – випадкові числа, які кажуть, скільки збудження передається через кожне з'єднання. Ніби синапси мозку ще не налаштовані. Мета бэкпропа — змінити ці ваги так, щоб мережа запрацювала: так що, коли ви передаєте зображення хот-дога на самий нижній шар, нейрон «хот-дога» в самому верхньому шарі порушується.

Припустимо, ви берете першу навчальну картинку із зображенням піаніно. Ви перетворите інтенсивність пікселів зображення 100 х 100 до 10 000 чисел, по одному на кожен нейрон нижнього шару мережі. По мірі того, як збудження поширюється по мережі відповідно з силою з'єднання нейронів в прилеглих шарах, все поступово доходить до останнього шару, одного з двох нейронів, які визначають, чи є на картинці хот-доги. Оскільки це картинка з піаніно, нейрон «хот-дога» повинен показати нуль, а нейрон «не хот-дога» повинен показати число вище. Припустимо, все працює не так. Припустимо, мережа помилилася щодо зображення. Бэкпроп — це процедура зміцнення сили кожного з'єднання в мережі, що дозволяє виправити помилку у наведеному прикладі навчання.

Як це працює? Ви починаєте з останніх двох нейронів і з'ясовуєте, наскільки вони помиляються: яка різниця між їх числами збудження і якою вона має бути насправді. Потім ви переглядаєте кожне з'єднання, що веде до цим нейронам — спускаючись нижче по верствам і визначаєте їх внесок у помилку. Ви продовжуєте робити це, поки не дійдете до першого набору сполук на самому дні мережі. До цього моменту ви знаєте, який внесок окремого з'єднання в загальну помилку. Нарешті, ви міняєте всі ваги, щоб в цілому знизити шанси на помилку. Цей так званий «метод зворотного поширення помилки» полягає в тому, що ви як би проганяє помилки тому по мережі, починаючи із протилежного кінця, до виходу.

Неймовірне починає відбуватися, коли ви робите це з мільйонами або мільярдами зображень: мережа починає добре визначати, зображений на картинці хот-доги чи ні. І що ще більшпримітно, так це те, що окремі верстви цих мереж для розпізнавання зображень починають «бачити» зображення так само, як це робить наша власна візуальна система. Тобто перший шар виявляє контури — нейрони збуджуються, коли контури є, і не збуджуються, коли їх немає; наступний шар визначає набори контурів, наприклад, кути; наступний шар починає розрізняти форми; наступний шар знаходить всякі елементи на зразок «відкритої булочки» або «закритої булочки», тому що активуються відповідні нейрони. Мережа організується в ієрархічні шари, навіть не будучи запрограмованої таким чином.

Справжній інтелект не ніяковіє, коли проблема трохи змінюється.

Саме це так вразило. Справа не стільки в тому, що нейронні мережі добре класифікують зображення з хот-догами: вони вибудовують репрезентації ідей. З текстом це стає ще більш очевидним. Можна згодувати текст Вікіпедії, багато мільярдів слів, простий нейронної мережі, навчивши її наділяти кожне слово числами, відповідними возбуждениям кожного нейрона в шарі. Якщо уявити всі ці числа координатами в складному просторі, ви знаходите точку, відому в даному контексті як вектор, для кожного слова в цьому просторі. Потім ви навчаєте мережу так, що слова, які з'являються поруч на сторінках Вікіпедії, будуть наділятися схожими координатами — і вуаля, відбувається щось дивне: слова, що мають схожі значення, будуть показуватися поруч в цьому просторі. «Божевільний» і «засмучений» будуть поруч; «три» і «сім» теж. Більш того, векторна арифметика дозволяє відняти вектор «Франції» з «Парижа», додати його до «Італії» і знайти «Рим» поблизу. Ніхто не говорив нейромережі, що Рим для Італії — це те, що Париж для Франції.

«Це дивно», говорить Хінтон. «Це шокує». Нейронні мережі можна розглядати як спробу взяти речі — зображення, слова, записи розмов, медичні дані — і помістити їх, як кажуть математики, багатовимірне векторний простір, в якому близькість або віддаленість речей буде відображати найважливіші аспекти цього світу. Хінтон вважає, що саме це робить мозок. «Якщо ви хочете дізнатися, що таке думка, — говорить він, — я можу передати її вам серією слів. Я можу сказати: «Джон подумав: «упс». Але якщо ви запитаєте: що таке думка? Що значить для Джона мати цю думку? Адже в його голові немає відкриваються лапок, «упс», що закриваються лапок, взагалі такого і близько немає. В його голові протікає якась нейронна активність». Великі картини нейронної активності, якщо ви математик, можна вловити в векторному просторі, де активність кожного нейрона буде відповідати числу, а кожне число — координаті дуже великого вектора. На думку Хінтона, думка — це танець векторів.

Тепер зрозуміло, чому Інститут Вектор назвали так?

Хінтон створює якесь поле спотворення реальності, передається вам відчуття впевненості і ентузіазму, вселяє віру в те, що для векторів немає нічого неможливого. Зрештою, вони вже створили самокеровані автомобілі, виявляють рак комп'ютери, миттєві перекладачі розмовної мови.

І тільки коли ви залишаєте кімнату, ви згадуєте, що ці системи «глибокого навчання» все ще досить дурні, незважаючи на свою демонстративну силу думки. Комп'ютер, який бачить купу пончиків на столі і автоматично підписує її як «купу пончиків, що лежать на столі», здається розуміючим світ; але коли та ж програма бачить дівчину, яка чистить зуби, і каже, що це «хлопчик з бейсбольною битою», ви усвідомлюєте, наскільки невловиме це розуміння, якщо воно взагалі є.

Нейронні мережі — це просто бездумні і розпливчасті распознаватели образів, і наскільки корисними можуть бути такі распознаватели образів — адже їх прагнуть інтегрувати в будь-яке програмне забезпечення — вони в кращому випадку представляють обмежену породу інтелекту, яку легко обдурити. Глибока нейронна мережа, яка розпізнає зображення, може бути повністю сконфужена, якщо ви зміните один піксель або додасте візуальний шум, непомітний для людини. Майже так само часто, як ми знаходимо нові способи застосування глибокого навчання, так само часто ми стикаємося з його обмеженістю. Самокеровані автомобілі не можуть їхати в умовах, яких не бачили раніше. Машини не можуть розбирати пропозиції, які вимагають здорового глузду і розуміння того, як влаштований світ.

Глибоке навчання в деякому сенсі імітує те, що відбувається в людському мозку, але поверхнево — що, можливо, пояснює, чому його інтелект виявляється таким поверхневим іноді. Бэкпроп не був виявлений в процесі занурення в мозок, спроби розшифрувати саму думку; він виріс з моделей навчання тварин методом проб і помилок у старомодних експериментах. І більшість важливих кроків, які були зроблені з моменту його появи, не включали нічого нового на тему нейробіології; це були технічні поліпшення, заслужені роками роботи математиків та інженерів. Те, що ми знаємо про інтелект, ніщо порівняно з тим, чого ми про нього поки не знаємо.

Девід Дювенод, асистент професора з того ж відділення, що і Хінтон, в Університеті Торонто, каже, що глибоке навчання схоже на інженерію до введення фізики. «Хтось пише роботу і каже: «Я зробив цей міст, і він стоїть!». Інший пише: «Я зробив цей міст, і він звалився, але я додав опори і він стоїть». І всі сходять з розуму по опорах. Хтось додає арку — і всетакі: арки це круто! З фізикою ж ви можете насправді зрозуміти, що буде працювати і чому. Ми тільки нещодавно почали переходити до хоч якогось розуміння штучного інтелекту».

І сам Хінтон каже: «На більшості конференцій говорять про введення невеликих змін замість того, щоб гарненько подумати і задатися питаннями: «Чому те, що ми робимо зараз, не виходить? З чим це пов'язано? Давайте зосередимося на цьому».

Погляд з боку важко скласти, коли все, що ви бачите — це просування за просуванням. Але новітній прогрес в області ШІ меншою мірою був науковим і більшою — інженерним. Хоча ми стали краще розуміти, які зміни поліпшать системи глибокого навчання, ми поки смутно уявляємо, як ці системи працюють і чи зможуть вони коли-небудь зібратися в щось настільки ж потужна, як людський розум.

Важливо зрозуміти, чи змогли ми витягти все, що можна, з бэкпропа. Якщо так, то нас чекає плато в розвитку штучного інтелекту.

Терпіння

Якщо ви хочете побачити наступний прорив, щось на зразок основи для машин з набагато більш гнучким інтелектом, ви повинні, по ідеї, звернутися до досліджень, схожим на дослідження бэкпропа у 80-ті роки: коли розумні люди здавалися, тому що їх ідеї не працювали.

Кілька місяців тому я побував в Center for Minds, Brains and Machines, багатоцільовий установі, розквартированому в MIT, щоб подивитися, як мій друг Еял Дехтер захищає свою дисертацію з когнітивної науці. Перед початком виступу його дружина Емі, його пес Рубі і його дочка Сюзанна підтримали його і побажали удачі.

Еял почав свій виступ з захоплюючого питання: як так вийшло, що Сюзанна, якій всього два роки, навчилася говорити, грати, стежити за розповідями? Що в людському мозку такого, що дозволяє йому так добре вчитися? Навчиться комп'ютер коли-небудь вчитися так швидко і плавно?

Ми розуміємо нові явища з точки зору речей, які ми вже розуміємо. Ми розбиваємо домен на шматки і вивчаємо його по частинах. Еял — математик і програміст, він думає про завдання — наприклад, зробити суфле — як про складних комп'ютерних програмах. Але ж ви не вчитеся робити суфле, заучуючи сотні дрібних інструкцій програми на кшталт «поверніть лікоть на 30 градусів, потім подивіться на стільницю, потім витягніть палець, потім...». Якби потрібно було робити це в кожному новому випадку, навчання стало б нестерпним, і ви зупинилися в розвитку. Замість цього ми бачимо в програмі кроки вищого рівня на кшталт «збийте білки», які самі по собі складаються з субпрограмм кшталт «розбийте яйця» і «відокремте білки від жовтків».

Комп'ютери цього не роблять і тому здаються дурними. Щоб система глибокого навчання розпізнала хот-доги, вам доведеться згодувати їй 40 мільйонів зображень хот-догів. Щоб Сюзанна дізналася хот-доги, просто покажіть їй хот-доги. І задовго до цього у неї з'явиться розуміння мови, яке йде сильно глибше розпізнання появи окремих слів разом. На відміну від комп'ютера, в її голові є уявлення про те, як працює світ. «Мене дивує, що люди бояться, що комп'ютери віднімуть у них роботу», говорить Еял. «Комп'ютери зможуть замінити юристів не тому, що юристи роблять щось складне. А тому що юристи слухають і говорять з людьми. У цьому сенсі ми дуже далекі від усього цього».

Справжній інтелект не смутится, якщо ви злегка змініть вимоги до вирішення проблеми. І ключовою тезою Еяла була демонстрація саме цього, в принципі, як змусити комп'ютер працювати таким чином: жваво застосовувати все, що він вже знає, до вирішення нових завдань, швидко схоплювати на льоту, стає експертом у зовсім новій області.

По суті, це процедура, яку він називає алгоритмом «дослідження-стиснення». Вона дає комп'ютера функцію програміста, збирає бібліотеку багаторазових модульних компонентів, що дозволяє створювати більш складні програми. Нічого не знаючи про новому домені, система намагається структурувати знання про нього, просто вивчаючи його, консолідуючи виявлене і далі вивчаючи, подібно дитині.

Його радник, Джошуа Тененбаум, — один з найбільш цитованих дослідників ШІ. Ім'я Тененбаума спливало в половині розмов, які я мав з іншими вченими. Деякі з ключових людей в DeepMind — команди розробників AlphaGo, легендарно обіграв чемпіона світу з гри в го в 2016 році — працювали під його керівництвом. Він залучений в стартап, який намагається дати самоврядним автомобілів інтуїтивне розуміння основ фізики та намірів інших водіїв, щоб ті краще передбачали, що відбувається в ситуаціях, з якими не стикалися раніше.

Тезу Еяла поки не застосовувався на практиці, навіть у програми не вводився. «Проблеми, над якими працює Еял, дуже і дуже складні», говорить Тененбаум. «Потрібно щоб пройшло багато поколінь».

Коли ми сіли випити по чашці кави, Тененбаум сказав, що досліджує історію бэкпропа заради натхнення. Протягом десятиліть бэкпроп був проявом крутий математики, здебільшого ні на що не здатної. У міру того, як комп'ютери ставали швидше, а техніка складніше, все змінювалося. Він сподівається, що щось подібне станеться з його власною роботою і роботами його учнів, але «це може зайняти ще декілька десятиліть».

Що стосується Хінтона, він переконаний, що подолання обмежень ІІ пов'язано зі створенням «мосту між інформатикою та біологією». Бэкпроп, з цієї точки зору, був тріумфом біологічно натхнених обчислень; ідея спочатку виходила не з інженерії, а зпсихології. Тому тепер Хінтон намагається повторити цей трюк.

Сьогодні нейронні мережі складаються з великих плоских шарів, але в неокортексі людини справжні нейрони вибудовуються не тільки горизонтально, але і вертикально, в стовпці. Хінтон здогадується, для чого потрібні ці стовпці — в зорі, наприклад, вони дозволяють розпізнавати об'єкти навіть при зміні точки зору. Тому він створює штучну версію — і називає їх «капсулами» — для перевірки цієї теорії. Поки що нічого не виходить: капсули не особливо поліпшили продуктивність його мереж. Але адже 30 років тому з бэкпропом було те ж саме.

«Це повинно спрацювати», говорить він про теорії капсул, сміючись над власною бравадою. «А те, що поки що не працює, що це лише тимчасове подразнення».

За матеріалами Medium.com

Більше:

Венера має газ, вироблений мікробами. Вчені знайшли іноземців?

Був припущення, що може бути життя на Венери Протягом багатьох років вчені шукають життя на Марсі. Але хто знає, може вони там не дивляться? У 2017 році дослідники з США та Великобританії почали шукати ознаки життя на Венері, яка є другою за величино...

Чи може мелатонін допомогти лікувати коронавірус?

Деякі лікарі вважають, що гормон сну допомагає при коронавірусі Схоже, що в переліку потенційних методів лікування COVID-19, які дослідники запропонували протягом декількох місяців пандемії, ще одне поповнення: мелатонін. Лікар в Техасі каже, що він ...

Що таке "гормон любові" і хто його не вистачає?

Окситоцин - гормон любові Людське тіло виробляє величезну різноманітність гормонів, кожен з яких виконує своє завдання. Наприклад, багато відомих ендорфінів приносять людям відчуття радості, а надлишок кортизолу сигналізує про стресовий стан людини. ...

Новини

Китайські роботи-дослідники полетять на Місяць замість людей

Всі роботи з дослідження Місяця будуть проводитися в автоматичному режимі, — China Daily, посилаючись на надану високопоставленим чиновником КНР інформацію. Програми дослідження Місяця, що включають в себе висадку місяцеході...

DARPA вкладає 100 мільйонів доларів у розробку генетичного зброї

Як повідомляє видання Guardian, Управління перспективних дослідницьких проектів США (DARPA) приступило до розробки зброї на основі генної інженерії. Для роботи над проектом відомство виділило 100 мільйонів доларів США. Нова зброя ...

Бактерій змогли перетворити в нанороботів

Нанороботи могли б бути дуже корисними для найрізноманітніших речей: з їх допомогою можна було б проводити операції, досліджувати недоступні раніше місця, проводити діагностику організму і доставляти ліки в певні місця людського т...

Вчені додали дві нові букви в генетичний код

Як відомо, для того щоб закодувати величезний обсяг інформації в генетичному коді, використовується всього 4 нуклеїнових кислот: аденін, гуанін, тимін і цитозин. У генетичному коді вони позначаються відповідними літерами — А...

Хвороби виявлятимуть, просто просканувавши сітківку

Періодична діагностика і профілактичні огляди допомагають виявити масу захворювань на ранній стадії, але деякі стани можуть бути діагностовані лише тоді, коли хвороба вже досить затягнулася. Крім того, багато жизнеугрожающие патол...

Створена перша напівсинтетичні бактерія з штучної ДНК

Вся біологічне життя на планеті Земля ґрунтується на чотирьох нуклеїнових (азотистих) підставах ДНК: A, T, C і G (аденін, цитозин, тимін і гуанін). Але що буде, якщо людині вдасться створити нові штучні нуклеїнові підстави і вшити...

Астрономи виявили 72 нові галактики

Завдяки використанню нового наукового інструменту MUSE (Multi Unit Spectroscopic Explorer), встановлений на Дуже великий телескоп (VLT Європейської південної обсерваторії в Чилі, астрономи змогли виявити 72 нові галактики. Відкрит...

Земляні черв'яки здатні жити і розмножуватися в марсіанському ґрунті

Дуже цікавий експеримент провели співробітники в Нідерландах. Вони запросили у американського космічного агентства NASA копію , відтворену, виходячи з даних, отриманих у ході кількох марсіанських місій, а потім помістили в цей гру...

Астрономи виявили екзопланету з орбітальним періодом 27 000 років

Кожна планета нашої Сонячної системи має значно відрізняється від інших орбітальним періодом обертання навколо Сонця. Наприклад, якщо у Землі один оборот навколо зірки займає 365,25 доби, то у того ж Марса це займає майже у два ра...

Штучний інтелект зануриться у всесвіт молекул в пошуку дивовижних ліків

Темної ночі, далеко від міського світла, зірки Чумацького Шляху здаються незчисленними. Але з будь-якої точки неозброєному оку видно не більше 4500 зірок. В нашій галактиці їх 100-400 мільярдів, галактик у Всесвіті і того більше. ...

Вчені з'ясували, як різні види алкоголю впливають на емоції

Ні для кого не секрет, що алкоголь безпосередньо пов'язаний з емоційним станом людини. Комусь він піднімає настрій, а когось, навпаки, вганяє в депресію. Когось спиртне розкріпачує, а кого-то робить більш агресивним і задерикувати...

Як збільшити можливості мозку?

Відомо, що по мірі старіння всі резерви нашого організму виснажуються, а органи і тканини починають поступово втрачати свою функцію. Згідно з численними дослідженнями, після 40 років обсяг головного мозку людини зменшується в сере...

Чи може матерія покинути горизонт подій під час злиття чорних дір?

Як тільки ви потрапите в горизонт подій чорної діри, ви вже ніколи його не покинете. Не існує швидкості, яку можна було б набрати, навіть швидкість світла, щоб вона дозволила вам вийти. Але в загальної теорії відносності простір в...

У амішів виявили мутації, які перемагають діабет і навіть старіння

Аміші, також відомі як аманіти, — це релігійна громада, що проживає в декількох штатах США і в Канаді. Аміші відрізняються простотою життя, одягу, небажанням приймати більшу частину сучасних технологій і зручностей. Представ...

Перший вибух на Чорнобильської АЕС був ядерним, вважають вчені

Пригода на Чорнобильській АЕС, що сталася 26 квітня 1986 року, стало однією з найстрашніших в історії людства. Раніше вважалося, що вибух на четвертому енергоблоці стався тому, що в ході експерименту неконтрольований нагрівання ро...

У Новій Зеландії запропонували боротися з тваринами-шкідниками за допомогою CRISPR

Технологія генного редагування CRISPR знаходить все більше різних застосувань. У Новій Зеландії, наприклад, вирішили з її допомогою позбутися гризунів та інших шкідників. Миші, поссуми, щури та інші гризуни завдають Нової Зеландії...

У Китаї хочуть побудувати космічний човник з атомним двигуном

У новому звіті, опублікованому Китайської корпорації аерокосмічної науки і техніки (CASC), присвяченому космічної програми Китаю, міститься безліч амбіційних завдань, які Корпорація ставить перед собою на найближчі 20 років. Про д...

Передбачити, як піде еволюція людей, неможливо

Всі ми знаємо, як виглядали неандертальці: виступаючі надбрівні дуги, товстий ніс, витягнутий череп, потужна кісткова структура і, ймовірно, руде волосся і веснянкувата шкіра. Можливо, ви скоса посматриваете на рудих, коли зустріч...

Вчені відкрили ще одну багатообіцяючу земплеподобную планету

Всього в 11 світлових роках від Сонячної системи астрономи виявили нову землеподобную планету з кліматом, який імовірно може підходити для життя. Слід зазначити, що після Проксими b це друга найближча до нас екзопланета, що володі...

13 науково підтверджених ознак того, що ви розумніші, ніж вам здається

Всі хочуть здаватися скромніше. «Хто розумний? Я? Та ні, мені просто пощастило...» Пов'язано це, напевно, в першу чергу з тим, що більшості з нас не хочеться бути об'єктом пильної уваги, або чиїхось забобонів. Звичайно, є й ті, ко...

Примітка (0)

Ця стаття не має коментарів, будьте першим!