你需要打开的"黑匣子"的人工智能,直到为时已晚

Source:

Source:

<几年来在1980年代,非法入境的学生的医学院的圣乔治医院伦敦分别选择采用高科技的方法。 一个计算机程序,第一,希望通过恢复,选择从所有应用程序的约2 000名候选人每年。 该程序分析记录的收据,通过研究特点的成功的申请者,并进行调整,直到其解决方法不一致的意见,选择委员会。

<<跨id="更283159">

<然而,该程序已经学会了寻找更好的成绩和学术成就。 四年之后实施的两个医生在医院发现,该程序通常拒绝妇女候选人和个人与非欧洲人的名字,不论其学术功绩。 医生发现,大约60个申请者的每一年,只是拒绝一个工作面试,因为他们的性别或种族。 该方案包括性别和种族偏见,在数据使用培训实际上,已经了解到,医生和外国人都不是最佳人选医生。

<三十年后,我们都面临着类似的问题,但有的内部损害是现在广泛分布,并使决策具有更高的风险。 人工智能算法的基础上学习机是到处都在使用,开始与政府机构为医疗保健,决策和预测基于历史数据。 研究模式中的数据,他们还吸收和偏见。 谷歌,例如,展示了更广告-有偿工作的妇女比男子;一天的航运,亚马逊将通过黑人宿舍,以及数字照相机都难以识别面是不是白色。

<它难以了解是否算法是有偏见的或公平的,因此考虑甚至计算机专家。 其中一个原因是,详细的新算法经常被认为是专利信息,所以仔细看守他们的所有者。 在更复杂的情况下,算法如此复杂,甚至创作者不知道他们是如何工作。 这个问题是所谓的"黑箱"的AI—我们不能看到内部分算法和理解他如何来作出决定。 如果你把它锁,我们的社会可能受到严重影响:在数字环境中实现的历史歧视,我们也打过许多年来,奴役和农奴制以对妇女的歧视。

<这些关切,表示中小型社区的计算机科学较早,现在越来越严重的转向。 在过去两年在这一领域有相当多的出版物有关透明度的人工智能。 随着这个日益增长的认识和责任感。 "你可以是任何东西,我们不应该建立什么?", 问凯特*克劳福德,研究员在Microsoft和共同创始人工智能研究院现在在纽约举行。

<"学习机器最后来脱颖而出。 现在,我们正试图使用它的数以百计的不同任务,在现实世界中,"所述的丰富的卡鲁阿纳,高级研究员。 "这是可能的,人们将能够部署恶意的算法,将大大影响社会的长期目标。 现在看来,突然她理解,这是一个重要的篇章,我们的区域"。

未经授权

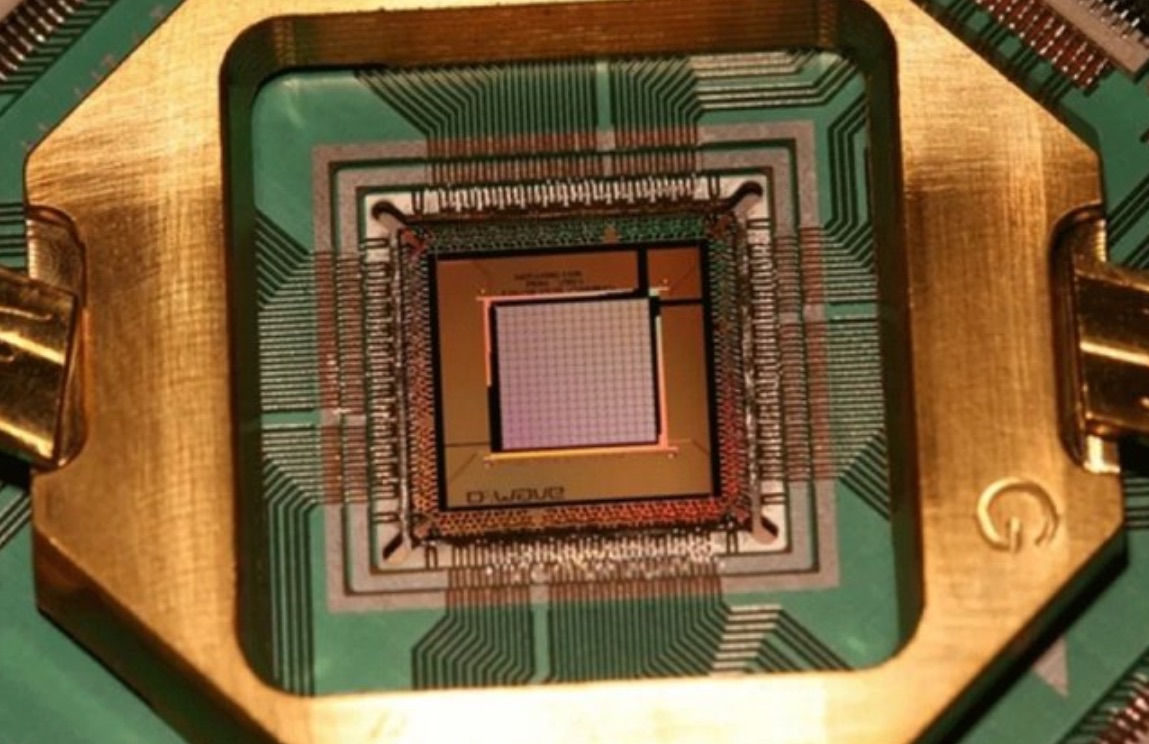

<我们一直在使用算法的,但问题的黑盒子已经没有先例。 第一个算法是简单和透明的。 他们中的许多我们仍然使用—例如,要评估的信誉。 每一个新的使用来调节。 <"的人使用算法,评估信用了几十年,但在这些领域是相当强的解决,其中增长在行使用的预测算法的"卡鲁阿纳所说的. 规定确保的预测算法给予解释的每一点:你被拒绝,因为你有很大信用,或者太低的收入。 <在其他领域,如法律和广告中,没有任何规则禁止采用故意neproschityvaemym算法。 你可能不知道为什么你已经拒绝贷款或没有得到这份工作是因为没有人强迫所有者的算法解释它是如何工作的。 "但我们知道,因为算法是训练在真实世界的数据,他们必须有偏见--因为真正的世界是有偏见,说:"卡鲁阿纳的。 <考虑,例如,语言是一个最明显的来源的偏见。 在算是受过训练的书面文字,它们形成了一些协会之间的话一起出现更加频繁。 例如,他们知道,"男子是一个计算机程序员和8212;是同一个女人被一个家庭主妇。" 当这个算法将指导,以找到一个很好的摘要作为一个程序,最有可能,他将选择男性候选人。 <这样的问题很容易解决,但是许多公司都不去。 相反,他们会隐藏这些不一致的后盾保护的信息。 没有访问的详细的算法,专家们在许多情况下将不可能确定的偏见或不. <为这些算法的秘密和保持超越了管辖权的监管者、公民几乎是不可能的起诉者的算法。 在2016年,最高法院的威斯康星州拒绝了该请求查看的内部运作的罗盘的。 男人、埃里克*卢米斯,被判处六年监狱中的部分原因是因为罗盘考虑他"高风险"。 卢米斯说,他的正当程序的权利受到侵犯的依赖法官的不透明的算法。 最终应用于诉讼程序在最高法院的联合国未能在六月至2017年。 <但隐秘的公司不会利用他们的自由于一个无限的时间。 通过日欧盟将通过法律,将需要企业有机会解释感兴趣的客户如何操作自己的算法和如何作出决定。 美国没有这样的立法发展。取证的黑盒

<无论监管部门都参与所有这一文化转变,在如何开发和部署的算法,可以降低患病率偏见的算法。 随着越来越多的公司和程序员都致力于使他们的算法,透明的和可以理解的,一些希望,公司不这样做,将失去一个良好的声誉眼中的公众。 <计算能力的增长已经允许我们创造算法的准确和可以理解的—这个技术挑战,开发者不能克服的历史。 最近的研究显示,它能够创建可以理解的模型预测的复发的犯罪的科目,以及究竟是如何的黑盒取证喜欢罗盘. <"一切都准备好了—我们知道如何建立模型,没有黑盒子,说:"辛西娅*鲁丁副教授计算机科学和电气工程在杜克大学。 "但不是那么容易吸引人们的注意这方面的工作。 如果政府机构将停止支付用于模型的黑盒,它会有帮助。 如果法官拒绝使用模型的一个黑盒子的判刑,这也将有所帮助。" <其他工作,来与的方式来检查有效性的算法,创建一个系统的检查和平衡的前算法将被释放到世界各地,只是作为试验的每一个新的药物。 <"的模式,现在是制和部署速度过快。 不进行适当的检查之前释放的算法,"说莎拉*谭康奈尔大学。 <理想情况下,开发应解除已知的偏见,例如,按性别、年龄和种族,以及运行的内部模拟来测试他们的算法在其他问题。 <与此同时,在到达的那一点的所有算法将是彻底的测试之前释放,是能够确定哪些人将遭受的偏见。 <在他的最新作品、tan、*卡鲁阿纳和他们的同事描述了一种新的方式来理解什么可能会发生的引擎盖下的一个黑盒子的算法。 科学家们创造了一个模型,该模型模拟算法的黑匣子学习,以评估风险的累犯根据罗盘的。 他们还创建了一模型的培训在现实世界的数据显示是否进行了预测再次犯罪。 比较的两个模型已允许科学家评估的准确性投影点,而不分析算法。 差异的结果的两个模型能够显示哪些变量,如种族或年龄,可能更重要的是在一个特定的模式。 其结果表明,罗盘偏见的针对黑人。 <精心设计的算法,可以消除长期建立的偏见,在刑事司法领域,治安和许多其他领域的社会。建议

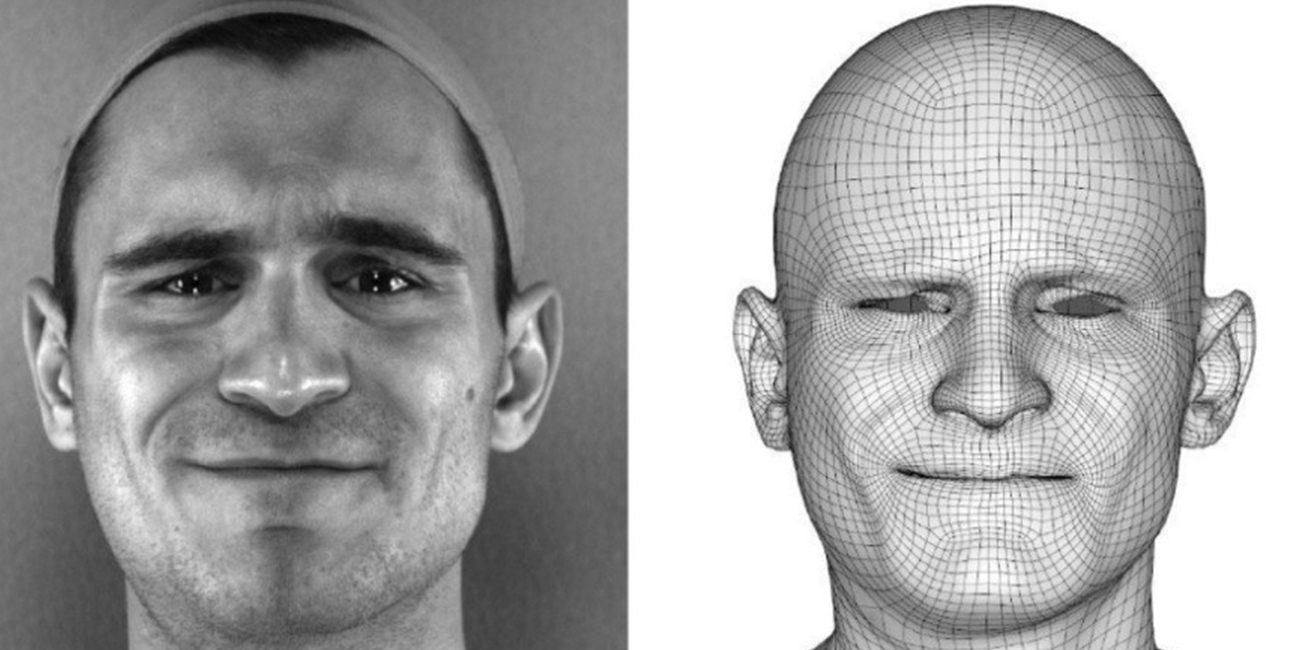

当将人成为不朽的通过数字技术。 我不相信它。 你呢? 在2016年,最小的女儿长JI-sen这个死于该疾病相关联的血液。 但在二月,母亲团聚与她的女儿在虚拟现实。 专家们模拟的电子版本的她的孩子,采用动作捕捉技术为一部纪录片。 戴耳机VR和触觉手套,江泽民能够行走、说话和一起玩这个数字版本的他的女儿。 绝望了解母亲,但实际上它甚至有点让人毛骨悚然。 这是我们的未来? 当然,我们的子孙会想要与我们这种方式? 我们仍然会. 或者不是? 让我们处理。 可以有不朽 一旦不朽是科幻小说,人们不会认为&#...

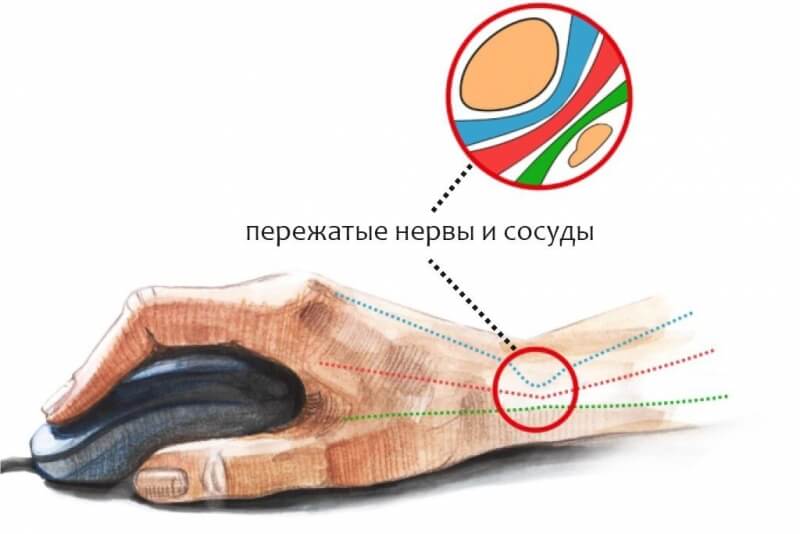

我最近进行了一次小型调查之中的朋友和熟人关于他们如何评估其有效性时,远程工作。 几乎每个人我知道—;现在的工作,从家庭与计算机和电话。 而且,事实证明,甚至那些以前去了城市和国家协商与客户—;今天,它成功地从家里工作同等效力(当然,这是不可能在所有地区)。 另一个有趣的现象是,更多现在的工作。 甚至你如我看到的这是花在计算机上的时间明显多每天比以前。 有关的原因,我们谈谈其他一些时间,但今天让我们谈谈影响的主体。 不断的工作在计算机可能会导致许多问题,但与这个非常容易的战斗,...

当你认为有关的未来、什么样的照片出现在你眼前? 作为情人的未来主义一类,其基础是代表的人民在过去对未来的,我总是想象的城市的未来建造的建筑物,例如对杂志,涵盖了1950年当中。 我的视力改变当我得知关于一种新的建筑样式–的参数或计算结构中存在的形式的前卫的设计超过十年。 随着时间的计算机技术的发展已经大大影响的风格:事实上,所有建筑在一个参数的样式设计人工智能。 然而,根据估计从哈佛大学设计学院(哈佛大学设计),引进艾建筑是在初始阶段。 在本文中,你会了解有关的原则的算法和不寻常的建筑物,与它已...

相关消息

...

...

...

...

...

...

评论意见 (0)

这篇文章已经没有意见,是第一个!